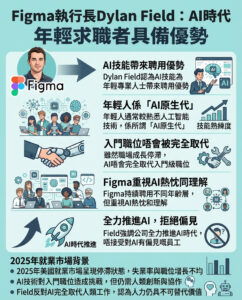

思考的代價

麻省理工學院(MIT)神經科學家發現,人類與新一代人工智能模型在解決複雜問題上的思考方式竟有驚人相似之處。

大型語言模型(Large Language Models,LLMs)如ChatGPT,能夠幾乎即時地撰寫文章或設計菜單,但過去它們在數學問題和複雜推理方面表現不佳。然而,最近這些模型在解決複雜問題方面取得了顯著進步。

這批新一代被稱為「推理模型」的LLMs,正被訓練以解決複雜問題。與人類一樣,它們需要時間來思考這些問題——令人驚訝的是,MIT麥戈文腦研究所的科學家發現,推理模型在處理問題時所需的「思考代價」與人類所需的時間成本高度相似。換言之,這些模型在需要大量計算的問題上,表現出與人類思考耗時相近的特徵。

這項研究由腦與認知科學副教授、麥戈文研究所研究員Evelina Fedorenko領導。她指出,推理模型與人類思考方式的相似並非刻意設計的結果,「模型設計者並不在意這些系統是否像人類一樣思考,他們只求系統能在各種情況下穩定運作並給出正確答案。這種趨同現象本身非常引人注目。」

推理模型的運作原理

這些新型推理模型屬於人工神經網絡的一種,透過大量數據學習如何處理資訊並解決問題。人工神經網絡在模仿大腦神經網絡的某些任務上表現出色,有研究指出表現最佳的模型在信息處理上與大腦有相似之處。但過去不少科學家質疑人工智能是否已具備處理複雜人類智能的能力。

Fedorenko坦言,直到不久前她仍認為這類模型在推理能力上仍有很長的路要走,直到最近出現的新一代推理模型才展現了解決數學問題和撰寫程式碼等思考任務的強大能力。

Fedorenko實驗室的博士後Andrea Gregor de Varda解釋,這些推理模型會分步解決問題。「研究人員意識到模型需要有更大的空間來進行複雜計算,當允許模型將問題拆解成多個步驟後,表現大幅提升。」

為了讓模型能逐步推理並得出正確答案,工程師們會採用強化學習,透過獎勵正確答案、懲罰錯誤答案的方式,讓模型在探索問題時強化有利行動,從而提高正確率。

這種訓練方式使推理模型比之前的LLMs更容易得出與人類相同的答案。雖然推理模型在回答時比前代模型花更多時間,但由於能提供正確解答,等待是值得的。

人類與模型的思考時間對比

推理模型需要時間逐步解決問題,這一點與人類思考有趣的相似:若要求人類立即解答難題,也很可能失敗。de Varda將推理模型與人類志願者同時測試相同問題,不僅比較答案是否正確,還追蹤他們解題所花的時間或努力。

對人類來說,研究者記錄了他們回答每個問題所需的毫秒數;對模型而言,因為計算時間受硬件影響較大,改以「tokens」(模型內部思考鏈中的單位)來衡量其思考量度。de Varda形容,tokens就像模型自己與自己對話的過程。

人類和模型被要求解決七類不同問題,包括數字運算和直覺推理。結果顯示,問題越難,人類花的時間越長,同時模型生成的tokens數量也越多。難度最高的問題類型「ARC挑戰」,涉及推斷並應用彩色網格間的轉換,對人類和模型而言都是最費思考代價的。

Fedorenko和de Varda認為,這種思考代價的高度一致性證明了推理模型在某種程度上正像人類一樣思考。但這並不表示模型在複製人類智能。他們仍想知道模型是否以與人腦相似的資訊表徵來處理問題,以及這些表徵如何轉化為解決方案。研究團隊也好奇模型能否處理需要世界常識、而非純文字資料的問題。

值得注意的是,儘管推理模型在解題時會產生內部「獨白」,但模型未必是用語言來思考。de Varda指出,這些內部計算往往包含錯誤或無意義的部分,即使最終答案正確,這說明模型的思考過程很可能發生在一個抽象、非語言的表徵空間,類似人類並非完全靠語言思考。

—

評論與啟示

這項研究揭示了人工智能推理模型與人類思考在「成本」上的驚人相似,為我們理解人工智能的運作機制提供了新視角。過去,AI經常被批評缺乏人類般的推理和理解能力,但這次發現表明,即使設計者不故意模仿人類思維,AI系統在解決具有挑戰性的問題時,竟然展現出與人類相似的「思考時間」模式。

這不僅挑戰了傳統上人類智能獨特性的看法,也促使我們重新思考人工智能的發展方向。推理模型分步解決問題的策略,與人類層層拆解困難任務的思維過程相映成趣。這種「自然收斂」暗示或許有某種普遍的認知架構——無論是生物大腦還是人工神經網絡——在處理複雜問題時都會面臨類似的計算限制和效率權衡。

此外,研究也提醒我們,人工智能的思維並非語言驅動,這與人類常將語言視為思考載體的直覺有所不同。模型的抽象表徵空間可能更接近人類潛意識或直覺層面的認知運作,而非顯性語言思維。這為認知科學和人工智能交叉研究提供了豐富的啟發,或許未來能促成更接近人類思考模式的AI系統。

然而,研究同時指出目前模型仍面臨挑戰,如處理需要豐富世界知識的問題。這提示我們,AI的真正智能不僅在於演算法和計算能力,更依賴於如何整合多元且深厚的知識體系。未來的AI發展,應該兼顧「思考效率」與「知識深度」,才能更全面地模擬人類智慧。

總括而言,這項研究不僅讓我們對AI的認知能力有了更清晰的理解,也啟發我們思考人類智能的本質與限制。隨著技術演進,人工智能和神經科學的結合將越來越緊密,促使兩者互相借鑒,推動智慧科技與人類認知研究的雙向突破。

以上文章由特價GPT API KEY所翻譯及撰寫。而圖片則由FLUX根據內容自動生成。