Google、Microsoft 及 Perplexity 在搜尋結果中推廣科學種族主義

Google、Microsoft 和 Perplexity 的AI驅動搜尋引擎正在展示被廣泛駁斥的種族科學研究,宣揚白人基因優越於其他種族的觀點。

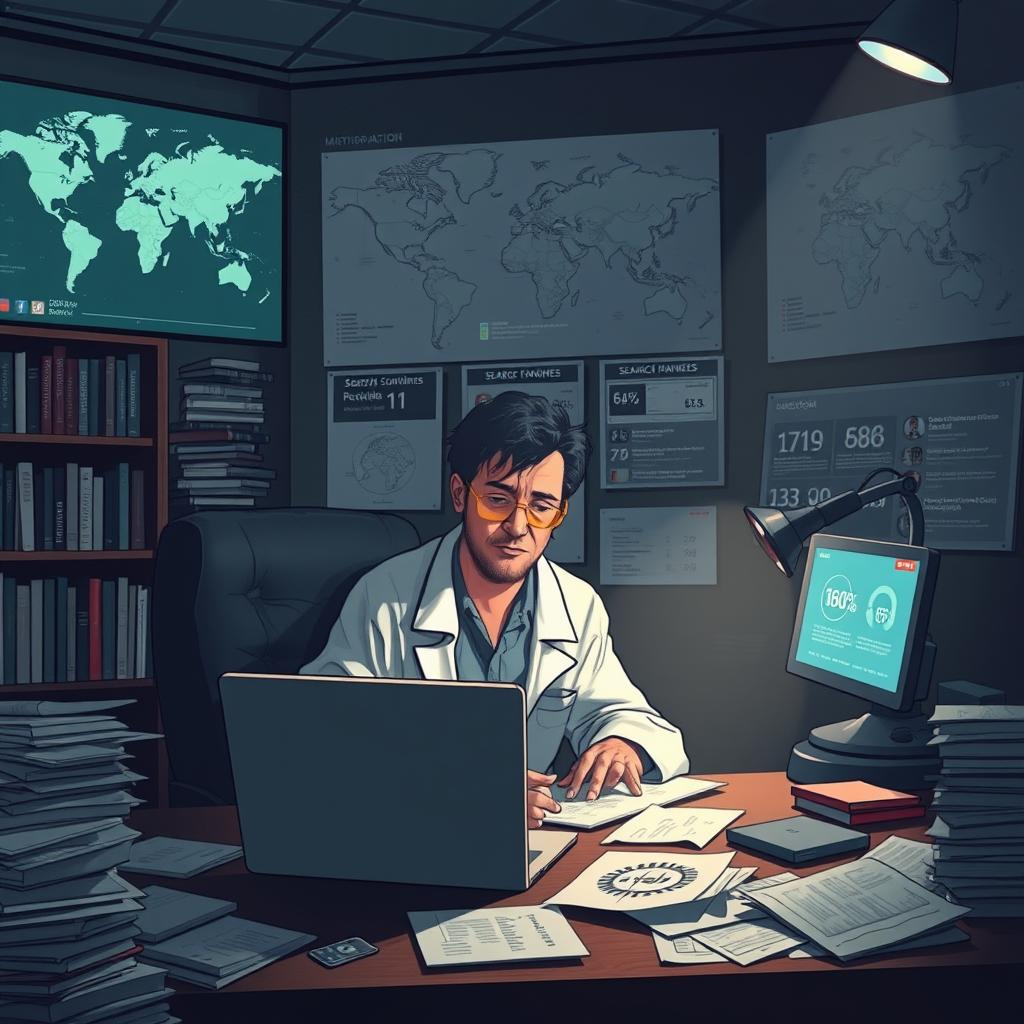

英國反種族主義組織Hope Not Hate的研究員Patrik Hermansson,正在調查種族科學運動的復甦。他需要查找更多關於一個被駁斥的數據集的信息,該數據集聲稱智商測試可以用來證明白人種族的優越性。

Hermansson正在調查由美國科技億萬富翁Andrew Conru資助的種族科學公司Human Diversity Foundation。該公司成立於2022年,是由1937年成立的Pioneer Fund的繼承者,該組織由美國納粹同情者創立,旨在推廣“種族改良”和“種族現實主義”。

Hermansson登入Google,查找各國的智商數據。當他輸入“巴基斯坦智商”時,Google的AI工具給出的答案是80。對於“塞拉利昂智商”,Google的AI工具甚至更具體:45.07。至於“肯尼亞智商”,結果是75.2。

Hermansson立即認出這些數字正是他試圖駁斥的研究中的數據,由已故的Richard Lynn教授發表,他是Pioneer Fund的長期主席。

WIRED的調查證實了Hermansson的發現,並發現其他AI搜尋引擎如Microsoft的Copilot和Perplexity在被詢問各國智商數據時,也引用了Lynn的研究。專家擔心,這些錯誤信息的推廣可能會幫助極端主義者進一步激化他人。

Brunel University London的文化與進化中心主任Rebecca Sear表示:“毫無疑問地使用這些‘統計數據’是非常有問題的。”她指出,Lynn的研究曾被2022年布法羅大規模槍擊案的兇手引用。

Google的AI概覽工具於今年早些時候推出,旨在為AI重塑的在線世界改造其強大的搜尋工具。該工具會從互聯網上提取信息,並在不需要點擊鏈接的情況下為用戶提供查詢答案。

然而,AI概覽工具的答案並不總是立即顯示信息來源。Google在收到投訴後,現在會在AI摘要的右側顯示其中一個鏈接的標題。Google表示,其系統並未按計劃運行,並正在尋找改進的方法。

評論

這篇文章揭示了科技巨頭在AI搜尋結果中未能有效過濾及處理錯誤信息的問題,特別是在涉及種族主義這樣敏感的議題時。AI技術的快速發展帶來了前所未有的便利,但同時也放大了錯誤信息的傳播速度和範圍。這不僅是一個技術問題,更是道德和社會責任的挑戰。

AI系統在提供信息時,應具備更高的準確性和可靠性,特別是當這些信息可能被用來支持極端主義或種族歧視的論調時。科技公司需要加強對AI技術的監管和控制,確保其不會無意中成為錯誤信息的擴音器。

此外,學術界也需反思對於問題研究的批判性評估,避免不當引用可能引發社會問題的研究。這是一個多方共同努力的課題,涉及技術、學術和社會的各個層面。AI技術的發展應該以促進社會進步和人類福祉為目標,而不是助長舊時代的偏見和歧視。

以上文章由特價GPT API KEY所翻譯