人工智能生成內容在馬杜羅被罷免後大肆流傳 — 真假難辨

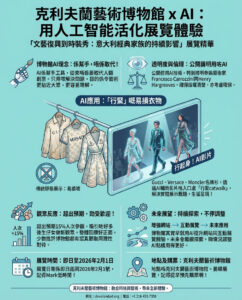

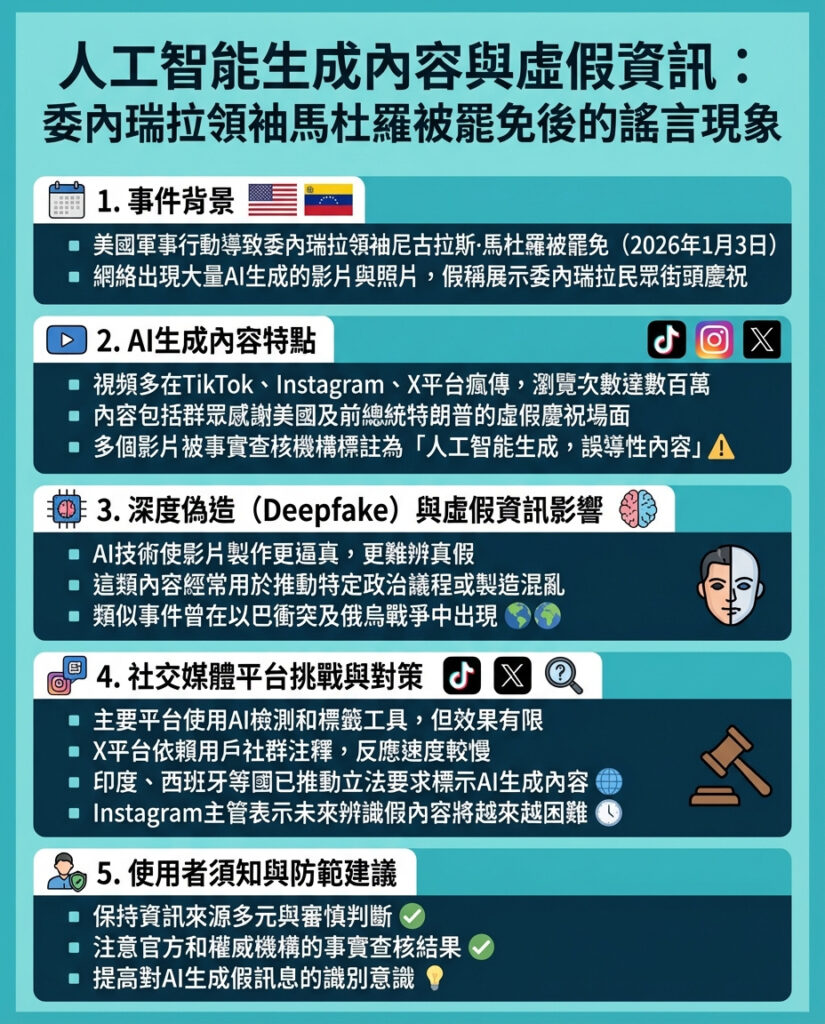

美國軍方在委內瑞拉展開行動,推翻該國領導人尼古拉斯·馬杜羅後,一系列聲稱展示委內瑞拉民眾街頭慶祝的人工智能(AI)生成影片迅速在社交媒體上爆紅。

這些由AI製作的影片,描繪了群眾歡慶的場面,已在TikTok、Instagram和X(前Twitter)等主要平台累積數百萬次觀看。

其中一段最早且廣泛被轉發的影片,來自一個名為「Wall Street Apes」的X帳號,該帳號擁有超過一百萬粉絲。影片中出現群眾流淚並感謝美國及時任總統川普推翻馬杜羅。

該影片後來被X上的「社群說明」功能標註為誤導內容,說明指出:「此影片為AI生成,現正被當作事實陳述以誤導觀眾。」

這段影片觀看次數超過560萬,至少被38,000個帳號轉發,包括商業大亨埃隆·馬斯克(Elon Musk)也曾轉發,後來他將其刪除。

CNBC無法確認影片的原始來源,但英國廣播公司(BBC)及法新社(AFP)的事實查核團隊指出,該影片最早版本出現在TikTok帳號@curiousmindusa,該帳號經常發布AI生成內容。

早在影片出現之前,就已有AI生成的圖片流傳,顯示馬杜羅被美國拘押的情景,這些圖片在川普政府發布真實拘押照片前就已出現。

這位被罷免的委內瑞拉總統於2026年1月3日被捕,美軍當日展開空襲和地面突襲,這場行動成為新年初全球頭條新聞。

除了AI影片外,AFP的事實查核團隊還指出多個關於馬杜羅被罷免的誤導性內容,包括被錯誤標示為委內瑞拉慶祝場面的美國慶祝活動影片。

重大新聞事件中誤導信息並非新鮮事,過去以色列-巴勒斯坦衝突及俄烏戰爭期間,也有類似虛假或誤導內容流傳。

然而,與委內瑞拉最新事態相關的AI生成內容,無論在規模還是真實感上,都明顯展示了AI作為誤導工具的最新進展。

平台如Sora和Midjourney使人們能更快速製作出超真實的影片,並在快速變化的新聞環境中冒充真實內容。

這類深偽技術(deepfake)常常用於推動特定政治敘事,或在全球觀眾中製造混亂。

去年,AI生成的影片中,有女性抱怨政府停擺期間失去補充營養援助計劃(SNAP)福利,該影片曾在Fox News被誤認為真實報導,後來該報導被刪除。

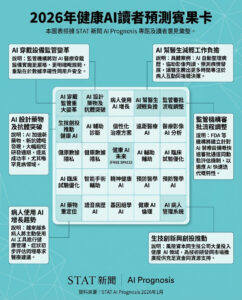

社交媒體公司面臨越來越大壓力,要加強標示此類AI生成內容。

去年,印度政府提出相關法律要求標示AI內容,西班牙則通過法例,對未標示的AI內容處以最高3,500萬歐元罰款。

TikTok、Meta等大型平台已推出AI偵測和標示工具,但成效參差不齊。

CNBC發現TikTok上有部分聲稱是委內瑞拉慶祝的影片,被標示為AI生成。

X平台主要依賴社群說明功能,但批評者認為該系統反應不夠迅速,難以阻止錯誤訊息在被標示前擴散。

Instagram和Threads主管亞當·莫塞里(Adam Mosseri)最近在一篇貼文中承認,隨著AI模仿現實能力提升,各大平台識別AI內容的難度將日益增加。

他表示:「越來越多人,包括我自己,相信未來識別真實媒體的指紋會比識別假媒體更實際。」

— CNBC記者Victoria Yeo提供協助報道

—

評論與啟示

這篇報道揭示了AI生成技術在當今信息戰中的雙刃劍角色。一方面,AI為內容創作帶來便利與創新;但另一方面,深偽技術的普及卻嚴重挑戰了新聞真實性和公眾判斷力。尤其是在國際重大政治事件發生時,虛假訊息快速傳播容易激化混亂,誤導民意,甚至影響政策決策。

值得注意的是,主流社交媒體平台目前仍未找到有效且及時的機制來遏止AI生成誤導內容的擴散,社群標註雖有一定作用,但速度與準確性不足以應對爆炸式的資訊量。這反映出技術進步與監管、管理能力之間存在明顯落差。

未來,除了依賴AI偵測工具,或許更需要從內容真實性溯源、媒體素養教育、法律規管等多方面協同努力。尤其如莫塞里所言,建立真實媒體的「指紋」識別系統,或許比僅僅試圖辨別假內容更為實際和可行。

對香港及全球媒體而言,這警示我們在報道敏感政治事件時,必須保持高度警覺,嚴格核實來源,避免成為虛假訊息的傳播者。讀者也應培養批判思維,不盲目相信網絡上看似真實的影像和資訊。

總之,AI技術的發展既帶來無限可能,也衍生重大挑戰。如何在享受AI帶來便利的同時,防範其被不法利用,將是媒體界和社會必須共同面對的課題。

以上文章由GPT 所翻譯及撰寫。而圖片則由GEMINI根據內容自動生成。