人工智能生成的人像幾乎無法分辨真假,連「超級面孔識別者」都難以識破

當大家擔心人工智能(AI)未來帶來的大量「劣質仿製品」淹沒我們時,鮮有人留意另一個更棘手的問題:當AI生成的作品質量高到與真人無異,甚至難以分辨時,會帶來什麼後果?

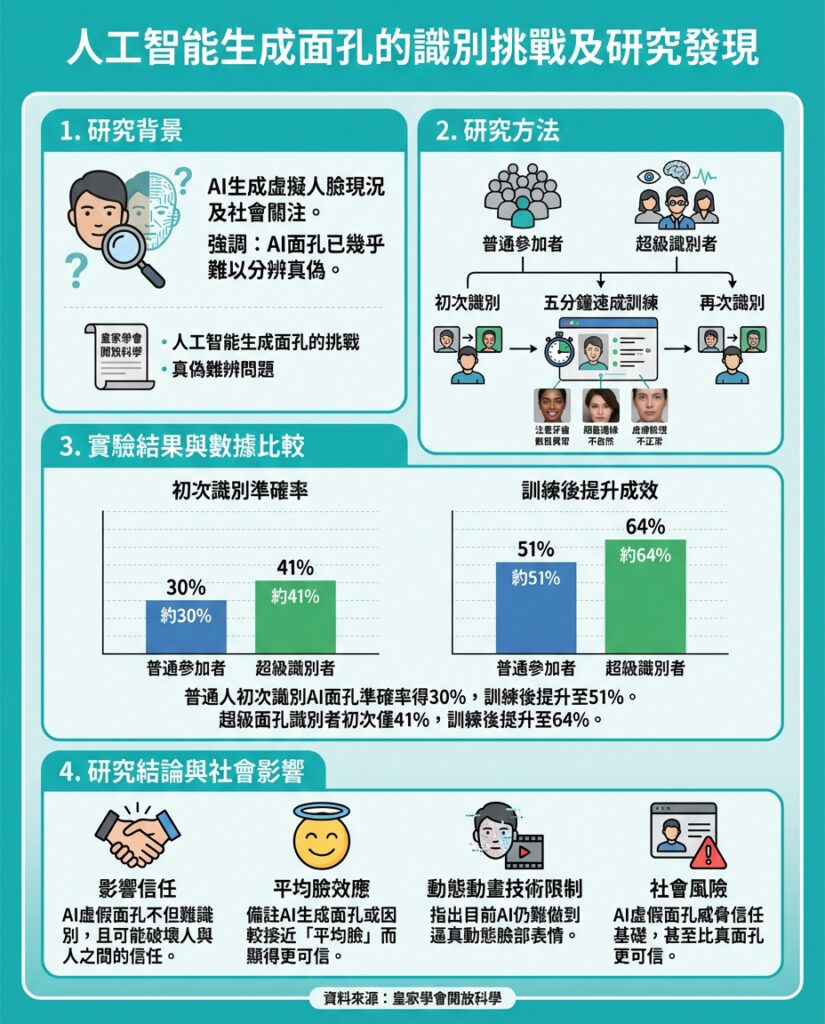

一篇發表於《皇家學會開放科學》(Royal Society Open Science)的新研究揭示,目前AI生成的人臉靜態圖像已經幾乎無法與真實照片區分。更令人擔憂的是,即使是經過專門訓練去發現AI生成痕跡的「超級面孔識別者」,也難以準確辨認。

研究由英國團隊進行,分別招募了一組普通人作為對照組,與一組具備極高面孔辨識能力的「超級面孔識別者」作為實驗組,值得注意的是,這些超級識別者之前並未接受過辨認AI生成圖像的訓練。

結果令人驚訝:對照組在判斷照片真假時,正確率僅有30%,明顯低於隨機猜測;超級識別者的表現也不理想,僅達41%。這顯示即使是面孔識別專家,也難以準確辨別AI合成的臉孔。

圖片說明:實驗中使用的刺激圖像,分別為女性合成臉(a)、男性合成臉(b)、女性真實臉(c)和男性真實臉(d)。最底行(e)是訓練時展示給參與者的合成圖像,標示出渲染缺陷,例如髮型紋理不自然及牙齒數量錯誤。圖源:Katie L. H. Gray 等/雷丁大學

接著,研究者只給兩組參與者短短五分鐘的訓練,教導他們如何鑑別AI生成的圖像。訓練內容包括注意一些異常特徵:嘴巴中間多餘的牙齒、奇怪的髮際線形狀、不自然的皮膚質感等,並配合視覺範例,還有參與者對初次判斷的反饋,幫助他們調整判斷策略。

接受訓練後,兩組的判斷能力明顯提升。普通組從30%上升至約51%,超級識別者則躍升至64%。

不過,這也引發一個關鍵問題:如果沒有事先提醒他們要懷疑照片的真實性,這些人又能否察覺到AI偽造的臉孔呢?

另一個有趣發現是,參與者錯誤地認為真實照片是假的比例也不低,這暗示AI不但能成功冒充真實臉孔,更可能破壞我們彼此間的信任。

更嚴重的是,有研究指出AI生成的人臉反而比真實臉孔更容易讓人覺得可信,原因可能是合成臉更接近「平均臉」,而平均臉通常被視為更值得信賴。

當然,這只是靜態臉孔的問題,現時AI仍未能在動態人臉動畫上做到完全逼真,通常仍需從真實照片出發,並且動畫效果尚未達到令人信服的程度。

—

評論與啟示

這項研究揭示了AI技術在逼真模擬人類面孔方面已經達到一個令人擔憂的高度。面對這種「真假難辨」的局面,社會必須正視兩大挑戰:第一是技術層面的辨識能力,第二是信任機制的維繫。

傳統上,我們依賴人類的直覺和專業能力來判斷信息真假,但這研究顯示,即使是被譽為「超級識別者」的專家,在未經特別訓練下,都難以識破AI生成的臉孔。這反映出未來辨識真偽的難度將大大提升,對於媒體、執法及個人隱私保護等領域都提出挑戰。

更值得深思的是,AI合成臉孔因為更「平均」而被視為更可信,這暗示我們的信任判斷可能被無形中操控。這種「可信假象」可能成為假新聞、詐騙甚至政治操縱的新工具,社會必須提前建立起相應的監管和教育機制。

最後,雖然動態臉孔的AI生成尚未成熟,但技術進步迅速,未來幾年內這一瓶頸或將被突破。屆時,辨識真偽的難度將進一步加劇,屆時的社會信任危機可能更加嚴峻。

總括而言,我們正站在一個科技與信任交織的新十字路口,如何在享受AI帶來便利的同時,保持對真實世界的判斷力和信任度,是未來每個人、每個組織都必須面對的重要課題。

以上文章由GPT 所翻譯及撰寫。而圖片則由GEMINI根據內容自動生成。