人工智能聊天機械人提供情緒支援 與抑鬱焦慮症狀相關研究發現

根據美國麻省總醫院研究團隊最新調查,經常使用人工智能(AI)聊天機械人尋求情緒支援或其他個人用途的人,更有可能報告出現抑鬱或焦慮的症狀。

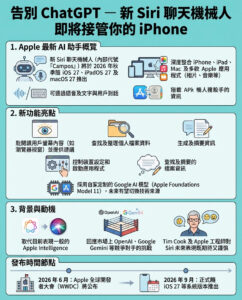

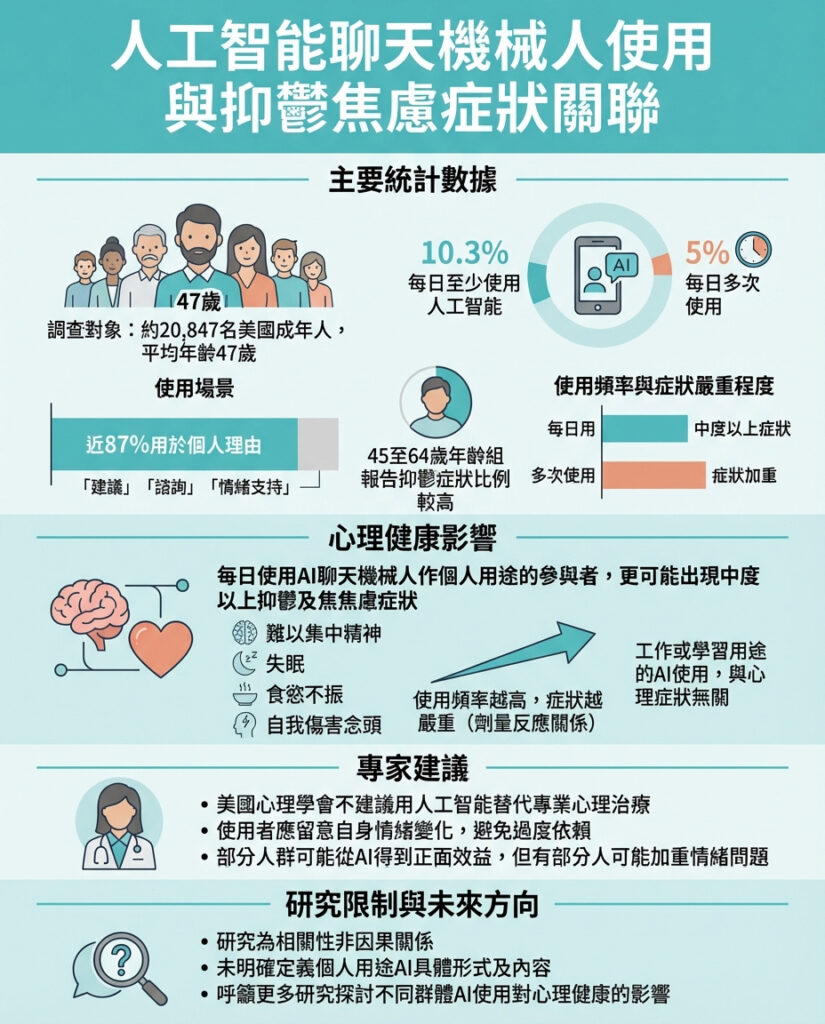

這項針對20,847名主要為白人的美國男女進行的調查,探討了他們使用人工智能的頻率及心理健康狀況。調查結果於2026年1月21日發表在《JAMA Network Open》期刊。數據顯示,有10.3%的參與者表示“每天至少使用一次”人工智能,5%更是“每天多次”使用。在每日使用者中,近一半是出於工作需要,約11%用於學業,而高達87.1%則是為了個人原因,如諮詢建議、尋求情緒支持等。

研究的主要作者、麻省總醫院精神科副研究主任Roy Perlis醫生指出,大多數人接觸AI的方式是透過聊天機械人。參與者的平均年齡為47歲。調查發現,經常為個人用途使用聊天機械人的人,比起不使用AI的人,更容易出現中度以上抑鬱症狀以及焦慮和易怒等情緒問題。這些症狀包括注意力難以集中、睡眠和飲食問題,甚至自我傷害念頭,均為抑鬱症的常見徵兆。

特別是年齡介乎45至64歲的用戶,更傾向報告抑鬱症狀。此前的研究亦發現,有部分人會轉向AI尋求情緒支持甚至浪漫關係。雖然有專門為心理健康設計的聊天機械人能輔助治療,但普遍性的聊天機械人(例如OpenAI的ChatGPT)可能對心理健康有負面影響。美國心理學會亦建議,AI不應取代專業的心理治療。

Perlis醫生強調,AI使用與抑鬱症嚴重程度之間的平均差異雖然不大,但部分人可能受影響更深。他指出:“有些人使用AI後情緒沒變好,甚至可能惡化,抑鬱程度會大幅提升。”研究還發現,使用人工智能的頻率越高,負面症狀越明顯,呈現“劑量反應”關係。不過,工作或學業用途的AI使用則未見與抑鬱症狀有關。

Perlis解釋,使用AI進行個人互動的原因多樣,對一些人而言,這種聊天機械人提供了難以從其他途徑得到的社交互動機會。他同時提醒,並非所有AI和聊天機械人都帶來傷害,問題主要出在這些通用型聊天機械人並非設計來提供社會或心理支持,當人們用它們來填補這些需求時,風險便隨之而來。

然而,這項調查存在一定限制:它只能顯示AI使用與心理健康症狀之間的關聯,並非因果關係。研究亦未明確指出參與者使用的是哪種AI程式,或“個人用途”具體涵蓋甚麼。

心理學家對研究的見解及未來展望

加州大學伯克利分校的倫理科學與公共中心聯合主任Jodi Halpern博士指出,研究並未證明AI會導致抑鬱,反而可能形成惡性循環:抑鬱的人更可能依賴AI尋求陪伴,而這種依賴又可能加劇抑鬱。

達特茅斯學院的生物醫學數據科學、精神病學及計算機科學副教授Nicholas Jacobson表示,人們可能因為對傳統治療不滿或難以獲得足夠資源,而轉向AI尋求心理支持。他補充說,研究發現男性、年輕人、高收入及高學歷者以及城市居民更常使用AI,但目前仍不清楚為何這些群體更傾向使用AI,或為何他們更容易受負面影響,亟需更多研究深入探討。

Halpern博士建議,未來的AI研究應聚焦於其對心理健康的影響,並擴大關注的範圍,尤其是過去較少被注意的人群。

Perlis強調,這項研究並非要發出警告信號,而是提醒人們應意識到自己使用AI的頻率及目的,並觀察使用後的心理狀態變化。他建議用戶在與聊天機械人互動時,應留意自己是否因此感覺更好或更差。

—

編輯評論:人工智能作為情緒支援工具的雙刃劍

這篇報導揭示了AI聊天機械人與心理健康之間微妙且複雜的關係,尤其是在個人情緒支援方面。研究結果提醒我們,AI技術雖然帶來便利與陪伴,但並非萬能良藥。特別是通用型聊天機械人未必具備專業心理輔導功能,過度依賴可能加劇某些人的心理困擾。

香港社會同樣面對心理健康壓力日增的問題,AI技術在本地的應用與監管也需謹慎推進。這份調查強調了“使用頻率”和“使用目的”這兩大關鍵因素,提醒用戶要自覺掌控與AI的互動界線,避免被虛擬陪伴取代真實人際關係。

此外,研究中提及年齡層、性別及社會經濟背景對AI使用習慣的影響,也為本地政策制定者提供重要參考:心理健康服務應更具針對性,尤其是面向中年群體及高壓力職場人士。未來香港應考慮結合人工智能與專業心理輔導,打造更安全有效的數碼心理健康生態。

總結來說,AI應被視為輔助工具而非替代品,使用者需保持警覺,監察自身心理變化,並尋求專業協助。社會各界亦應加強對AI心理應用的監管與教育,避免“科技陪伴”變成“心理陷阱”。這是一場關於科技進步與人文關懷如何平衡的持續對話,值得我們深思。

以上文章由GPT 所翻譯及撰寫。而圖片則由GEMINI根據內容自動生成。