OpenAI計劃於ChatGPT加入廣告,開啟危險影響的新大門

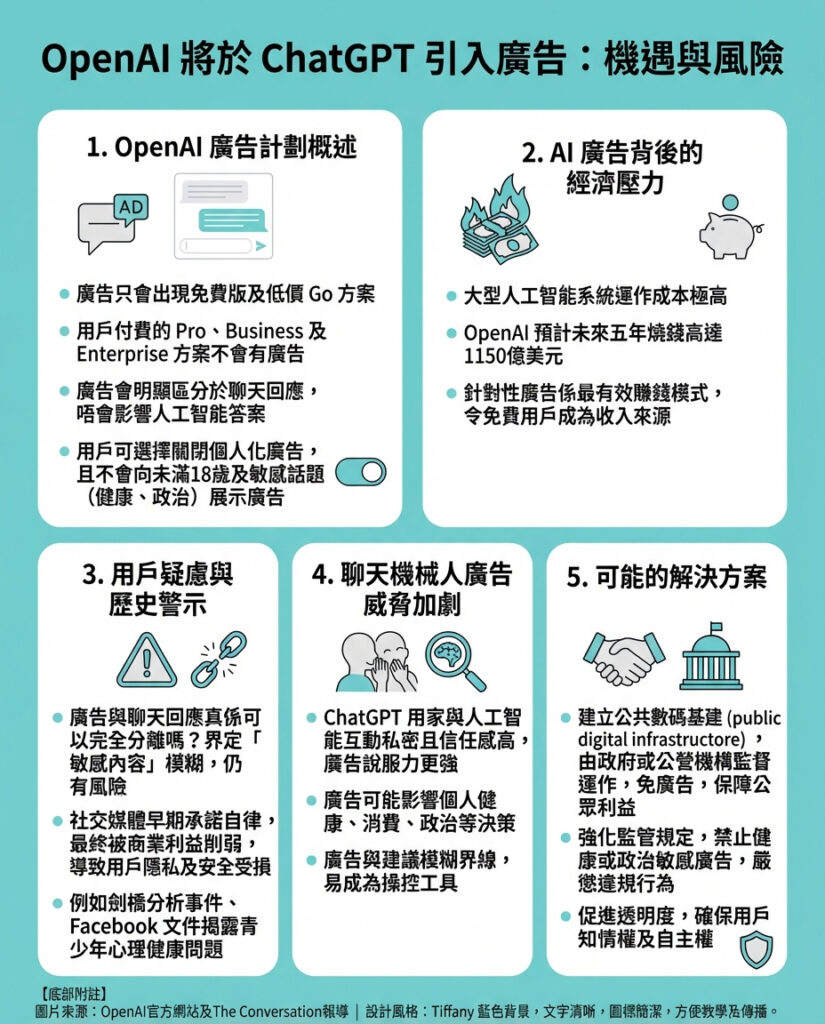

OpenAI最近宣布,將在美國的ChatGPT免費版本及低價的Go方案中加入廣告,但Pro、Business及Enterprise訂閱用戶則不受影響。公司聲稱廣告會清晰區分於聊天機器人的回應之外,且不會影響其輸出內容。他們亦承諾不會出售用戶對話記錄,允許用戶關閉個人化廣告,並避免向18歲以下用戶或圍繞健康、政治等敏感話題投放廣告。

儘管如此,此舉已引起部分用戶的擔憂,關鍵問題在於OpenAI的自我保護措施,在廣告成為其核心營收來源後,是否能夠真正落實。

為何AI加入廣告幾乎是必然的走向

十五年前,社交媒體平台面對龐大用戶群,卻難以盈利。突破口是針對性廣告,根據用戶的搜尋、點擊和關注度來定製廣告內容。這種模式成為Google和Facebook的主要收入來源,並促使它們不斷優化服務以最大化用戶參與度。

大型人工智能系統的運營成本極高,訓練和運行先進模型需要龐大的數據中心、專用晶片和持續的工程投入。儘管用戶快速增長,許多AI公司仍處於虧損狀態。OpenAI預計未來五年將燒掉約1150億美元。

只有少數公司能承擔這些成本,對大多數AI供應商來說,建立可擴展的收入模式迫在眉睫,而針對性廣告是最明顯的選擇,也是從大規模用戶中獲利的最可靠方法。

從歷史看OpenAI的承諾是否可信

OpenAI表示會將廣告與回答分開,並保護用戶隱私。這些承諾聽來令人安心,但目前仍較為模糊且易於解讀。公司提到不會在「健康、心理健康或政治」等敏感或受監管話題附近展示廣告,但對於何謂「敏感」、健康範疇界定多廣,以及誰決定界線等問題,並未給出明確說明。

大部分與AI的真實對話都不在這些狹義範圍內。OpenAI尚未透露哪些廣告類別會被允許或禁止。若無限制,試想一位用戶詢問「如何在壓力大的一天後放鬆」,可能會看到酒精外送廣告;查找「週末娛樂點子」時,可能會出現賭博推廣。

這些產品與公認的健康及社會危害有關。當這類廣告與個人化建議同時出現,會在決策時刻微妙而強力地影響行為,即使對話中未直接提及健康問題。

早年社交媒體的自我規範承諾也曾類似,但歷史顯示,在商業壓力下,自我管理往往失效,最終企業受益而用戶受害。

廣告的誘因長期以來破壞公共利益。劍橋分析醜聞揭露了個人數據如何被用於政治影響;「Facebook文件」顯示Meta明知平台對青少年心理健康造成嚴重傷害,卻抵制改變以保護廣告收入。最近調查亦發現,Meta在被警告後仍從詐騙廣告中獲利。

ChatGPT等聊天機器人帶來更大風險

聊天機器人並非普通的社交媒體信息流。人們以親密且私人化的方式使用它們尋求建議、情感支持和私密反思。這些互動感覺較為低調且無評判,常促使用戶透露不會公開說出的信息。

這種信任放大了說服力,遠超社交媒體。當用戶尋求幫助或做決策時,即使廣告與回應形式上分離,廣告仍出現在私密、對話式的環境中,而非公開信息流。

在個人化建議旁邊出現的廣告——無論是產品、生活方式、財務還是政治相關——都比在瀏覽時看到的同類廣告更具影響力。

隨著OpenAI將ChatGPT定位為財務、健康等多領域的「超級助手」,建議與說服之間的界線變得模糊。

對騙徒和極權者來說,這是一種更強大的宣傳工具。對AI供應商而言,迎合這些需求的經濟動機難以抗拒。

根本問題是結構性利益衝突。廣告模式激勵平台最大化用戶參與度,而最能吸引注意力的內容往往是誤導性、情緒化或對健康有害的。

這就是為何線上平台的自我約束屢屢失敗。

有沒有更好的出路?

一個選擇是將AI視為數碼公共基建:這些是旨在服務公眾而非最大化廣告收入的基礎系統。

這不排除私營企業參與,但至少需要一個高質素的公共選項,由民主機制監督,類似公共廣播與商業媒體並存。

這類模式已有雛形。瑞士透過大學及國家超級計算中心開發了公開資助的AI系統Apertus,該系統開源、符合歐盟AI法規,且無廣告。

澳洲可以走得更遠。除了打造自家AI工具,監管機構還可對商業供應商規定明確規則:強制透明、禁止有害健康及政治廣告,並對嚴重違規行為施加罰則,甚至關閉服務。

廣告並非一夕間腐蝕社交媒體,而是逐步改變激勵機制,最終令公共利益成為私利犧牲品。將廣告引入被廣泛信任的對話式AI,風險同樣巨大。

關鍵問題不是技術,而是政治:AI應該服務公眾,還是廣告商和投資者?

—

評論與思考

OpenAI這次加入廣告的決定,表面上看似合理的商業模式轉型,但實際上卻埋下了潛在的風險和倫理困境。AI不只是工具,更成為人們情感和決策的重要依靠。當廣告滲透進這個私密的對話空間,如何確保不被誤導,如何避免對弱勢用戶造成傷害,是一個極具挑戰性的問題。

OpenAI雖然做出多項承諾,但這些承諾大多語焉不詳,缺乏具體的監管和透明度。歷史告訴我們,依靠企業自律很難維持長期的公正與安全。特別是在涉及健康、心理及政治等敏感領域時,模糊的界線容易被利益驅動所利用。

此外,聊天機器人作為「超級助手」的角色,讓廣告的影響力遠超傳統媒體。用戶在尋求真誠建議時,若被隱藏的廣告所左右,可能影響其生活決策甚至健康,這種影響不容忽視。

因此,或許我們應該思考如何建立公共監管機制,甚至公共AI服務,保障用戶權益,而非讓利潤驅動的私企主導未來AI生態。這不只是技術問題,更是關乎社會價值和民主治理的重大議題。香港及全球的用戶,都應該對這類發展保持高度警覺,積極參與討論,爭取一個更安全、透明和公平的AI未來。

以上文章由GPT 所翻譯及撰寫。而圖片則由GEMINI根據內容自動生成。