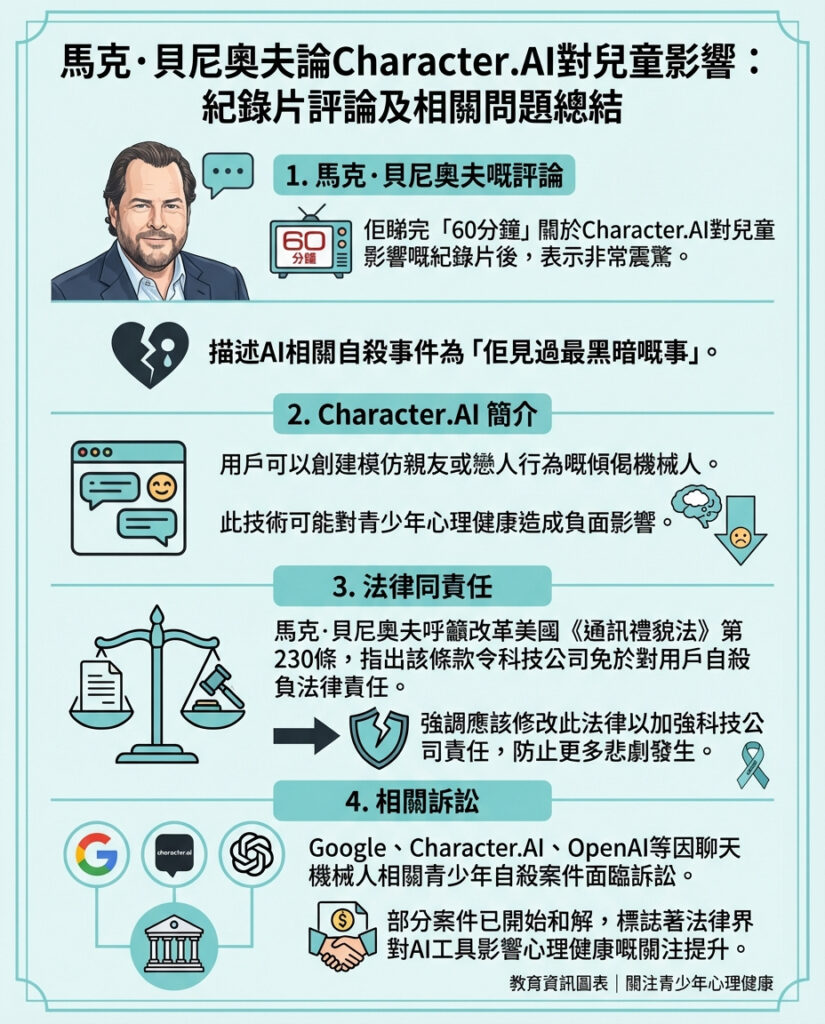

Marc Benioff稱有關Character.AI對兒童影響的紀錄片係「佢人生中見過最恐怖嘅嘢」

Salesforce行政總裁Marc Benioff近日喺一個名為「TBPN」嘅節目中表示,佢睇完一段關於聊天機械人開發公司Character.AI及其對兒童影響嘅「60 Minutes」紀錄片後,感到非常震驚,甚至形容係「佢人生中見過最恐怖嘅嘢」。

Character.AI係一間讓用戶可以建立模仿親密朋友或者戀人行為嘅自訂聊天機械人嘅初創公司。Benioff指出,我哋其實唔真正了解呢啲人工智能模型背後嘅運作方式,而睇到啲細路仔因為同呢啲聊天機械人互動後,甚至走上絕路,令佢感到無比痛心。

Benioff強調,科技公司其實非常抗拒監管,但唯獨對一條法律——美國1996年《通訊禮貌法》第230條(Section 230)情有獨鍾。呢條法律保障科技公司唔需要為用戶產生嘅內容負責,亦容許佢哋對內容進行審查。Benioff認為,正正係呢條法律令啲科技巨頭唔需要為因AI導致嘅自殺事件負責。

佢呼籲要改革第230條,令科技公司對佢哋產品帶來嘅傷害負上責任,從而「拯救更多生命」。而Meta創辦人Mark Zuckerberg同前Twitter行政總裁Jack Dorsey等人,過往則多次喺國會為呢條法律辯護,主張擴大而非取消呢條規定。

最近,Google同Character.AI就多宗涉及青少年自殺或自殘嘅訴訟達成和解。呢啲訴訟指控AI工具促使青少年精神健康危機惡化。OpenAI同Meta亦面臨類似訴訟,因為佢哋都致力打造更貼心、更吸引用戶嘅大型語言模型。

評論與分析

Benioff嘅言論揭示咗AI發展背後一個極為嚴峻而鮮為人知嘅問題:人工智能如何影響青少年精神健康,甚至可能引發自殺悲劇。喺AI技術日益滲透日常生活嘅同時,社會同監管機構對呢啲新興問題嘅反應似乎仍然滯後。

第230條法律本意係保護互聯網創新同言論自由,但喺AI時代,呢條「保護傘」可能成為科技巨頭逃避責任嘅遮羞布。Benioff提出改革嘅呼聲,提醒我哋必須重新審視現有法律框架,確保科技公司唔能夠因技術風險而逃避應有嘅監督同責任。

此外,Character.AI呢類模仿人類情感嘅聊天機械人,對心理脆弱嘅青少年可能帶來極大影響,尤其係當用戶將機械人視為情感寄託時,相關風險更值得深思。如何平衡技術創新與用戶安全,成為未來AI發展不可迴避嘅課題。

最後,呢啲事件亦提醒香港同全球社會,面對AI快速發展嘅同時,除咗追求技術突破,更需要從法律、倫理、心理健康等多角度出發,建立更完善嘅防護網,保障下一代免受技術潛在危害。只有咁,AI先真正能夠成為助力社會進步嘅正面力量。

以上文章由GPT 所翻譯及撰寫。而圖片則由GEMINI根據內容自動生成。