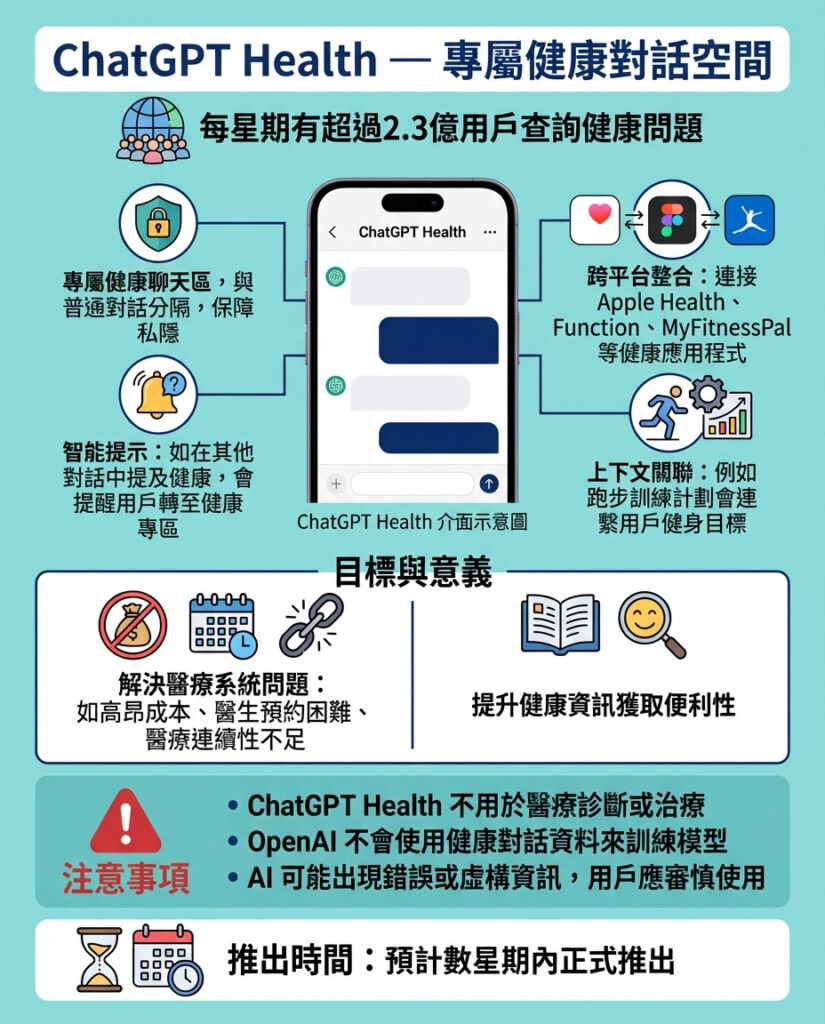

OpenAI 推出 ChatGPT Health,稱每週有2.3億用戶查詢健康問題

OpenAI 於本週三宣布推出全新功能 ChatGPT Health,為用戶提供一個專門討論健康相關話題的空間。公司指出,目前每週已有超過2.3億人次在 ChatGPT 平台上提出健康和醫療相關的問題。

這項新功能將健康對話與一般聊天分開,確保健康資訊不會在其他對話中被提及。如果用戶在非健康專區開始討論健康問題,AI 會主動引導用戶轉至 ChatGPT Health 專區。

在這個專區內,AI 甚至可以參考用戶在一般聊天中提及的資訊,例如如果你在普通對話中請求制定馬拉松訓練計劃,AI 就會知道你是跑步愛好者,並於健康對話中根據這些資訊提供更貼合的建議。

此外,ChatGPT Health 能與 Apple Health、Function、MyFitnessPal 等健康應用程式整合,使用戶的個人健康資料和醫療記錄能夠被納入對話參考。OpenAI 強調,健康對話的內容不會被用來訓練其 AI 模型。

OpenAI 應用部門行政總裁 Fidji Simo 在部落格中表示,ChatGPT Health 是針對現時醫療體系中存在的成本高昂、醫療資源不足及醫療服務不連續等問題的回應。

不過,使用 AI 聊天機器人作為醫療諮詢工具亦帶來不少挑戰。大型語言模型(LLM)如 ChatGPT 是基於預測最可能的回應來運作,而非保證答案的準確性,且 AI 容易出現「幻覺」現象,即生成錯誤或虛假的資訊。

OpenAI 服務條款亦明確指出,ChatGPT 不適用於診斷或治療任何健康狀況。

ChatGPT Health 預計將於未來數週內逐步推出。

—

評論與啟示

OpenAI 推出專門的 ChatGPT Health 功能,正反映出人工智能在醫療健康領域的日益重要與普及。每週高達2.3億人次的健康查詢,充分顯示用戶對 AI 在健康諮詢上的依賴和期待。將健康對話獨立劃分,既保護用戶隱私,也避免混淆對話上下文,這是設計上的一大進步。

不過,AI 在醫療上的應用必須謹慎。大型語言模型本質上無法保證資訊的真確性,這在關乎生命健康的問題上尤其關鍵。用戶若過度依賴 AI 給出的建議,可能忽略了專業醫生的診斷和治療,帶來潛在風險。因此,OpenAI 強調 ChatGPT 不可用於診斷或治療,明確界定其輔助性質是必須的防線。

從更宏觀角度看,ChatGPT Health 反映了醫療服務數碼化的趨勢,尤其在醫療資源不足或醫療成本高昂的背景下,AI 成為一種輔助工具,有望改善醫療可及性和效率。然而,如何確保 AI 回應的安全性與可靠性,防止誤導用戶,仍是業界和監管機構面對的重要課題。

對香港及全球用戶而言,這種技術的發展既帶來便利,也提醒我們要有判斷力,將 AI 作為參考,而非唯一依靠。未來如何平衡創新與安全,建立用戶信任,將決定這類 AI 健康工具的真正價值與影響力。

以上文章由GPT 所翻譯及撰寫。而圖片則由GEMINI根據內容自動生成。